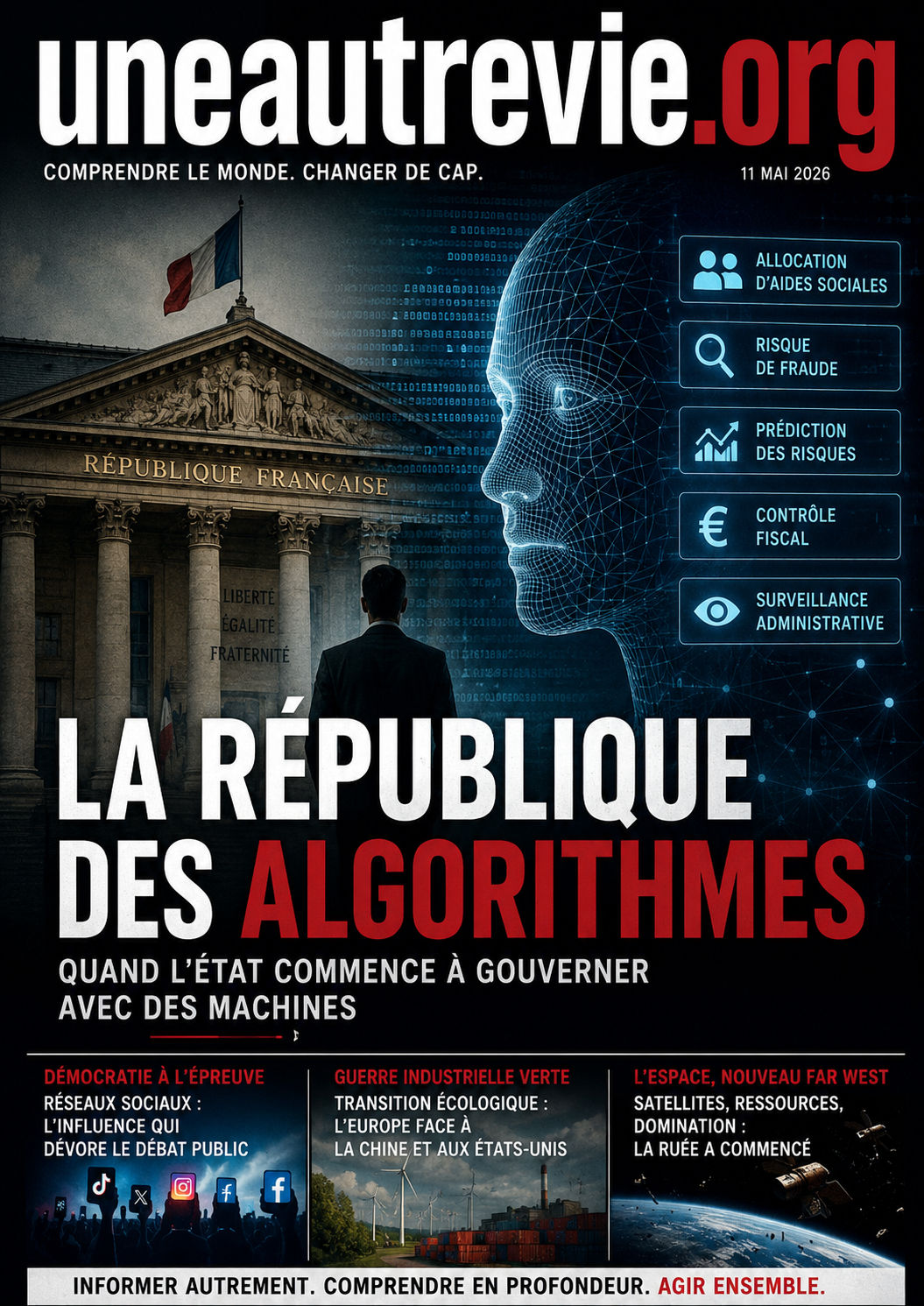

Quand l’État commence à gouverner avec des machines

Pendant longtemps, l’intelligence artificielle a été présentée comme un gadget amusant capable d’écrire des poèmes douteux, de générer des images de chats en armure médiévale ou d’aider des étudiants à rendre des dissertations rédigées avec l’enthousiasme émotionnel d’un grille-pain.

Pendant ce temps-là, discrètement, sans musique dramatique ni conférence TED sur fond de coucher de soleil californien, les administrations publiques ont commencé à expérimenter autre chose : l’automatisation du pouvoir.

Le sujet paraît technique. Il est en réalité profondément politique.

Car derrière les mots anodins de “modernisation”, “optimisation”, “pilotage par la donnée” ou “aide à la décision”, une transformation majeure est en cours :

l’État commence à penser avec des algorithmes.

Et la plupart des citoyens n’en ont pratiquement aucune conscience.

Le Bulletin Quotidien rappelle d’ailleurs que l’OCDE alerte sur le retard des administrations dans l’usage de l’intelligence artificielle, tout en soulignant le manque de gouvernance cohérente dans les fonctions régaliennes.

En clair : les États avancent vite, mais souvent sans véritable doctrine démocratique. Une spécialité moderne. Comme construire des centrales nucléaires avant de savoir où stocker les déchets.

L’administration rêvait d’efficacité

Soyons honnêtes : la tentation est immense.

Quel ministre ne rêverait pas :

- d’anticiper les fraudes fiscales,

- de détecter automatiquement les dossiers suspects,

- d’optimiser les dépenses publiques,

- de prédire les risques sociaux,

- ou de traiter des millions de documents administratifs sans embaucher davantage de fonctionnaires ?

Pour des États endettés jusqu’au plafond, l’IA ressemble à un miracle comptable.

Un algorithme ne fait pas grève.

Il ne demande pas d’augmentation.

Il ne dort jamais.

Et surtout, il produit des tableaux Excel qui donnent aux dirigeants l’impression rassurante de maîtriser le chaos.

Le problème, évidemment, c’est que gouverner un pays ne consiste pas uniquement à trier des données comme Amazon trie des colis.

Un citoyen n’est pas une ligne statistique.

Enfin… en théorie.

La France expérimente déjà

Le rapport évoqué dans le BQ souligne que la France multiplie les projets pilotes :

- santé,

- justice administrative,

- automatisation de traitements,

- gestion des courriels,

- outils prédictifs.

Mais tout cela reste fragmenté.

Chaque ministère développe ses outils.

Chaque administration avance dans son coin.

Sans véritable stratégie globale.

Sans doctrine publique claire.

Sans contrôle démocratique structuré.

Autrement dit :

l’État construit progressivement un cerveau algorithmique… sans avoir réellement décidé qui en serait responsable.

C’est un peu comme installer le pilote automatique sur un avion avant d’avoir lu le manuel. Certes, ça peut fonctionner. Jusqu’au moment où ça ne fonctionne plus du tout.

Le fantasme de l’objectivité

L’argument favori des technocraties est connu :

les algorithmes seraient “neutres”.

C’est faux.

Un algorithme apprend à partir de données humaines.

Et les données humaines contiennent :

- des biais,

- des inégalités,

- des discriminations,

- des erreurs,

- des choix politiques.

Un système de détection de fraude apprendra à surveiller davantage certains profils que d’autres.

Un outil prédictif policier ciblera certains territoires.

Un système administratif privilégiera certains comportements jugés “normaux”.

L’algorithme ne supprime pas les biais humains.

Il les industrialise.

Avec une efficacité redoutable.

Et surtout avec une opacité inquiétante.

Parce qu’un fonctionnaire peut être contesté.

Un ministre peut être auditionné.

Un élu peut être sanctionné.

Mais comment conteste-t-on une décision produite par un système algorithmique opaque développé par un prestataire privé utilisant des modèles impossibles à expliquer ?

Bienvenue dans la bureaucratie du brouillard numérique.

La tentation sécuritaire

C’est ici que le sujet devient explosif.

Car les États découvrent que l’intelligence artificielle n’est pas seulement un outil administratif.

C’est aussi un formidable instrument de surveillance.

Reconnaissance faciale.

Analyse comportementale.

Croisement massif de données.

Détection automatisée d’anomalies.

Prédiction des risques.

Le rêve absolu de toutes les bureaucraties depuis l’invention du tampon encreur.

La Chine pousse cette logique à grande échelle avec son modèle techno-autoritaire assumé.

Les États-Unis avancent via les géants privés de la Silicon Valley.

L’Europe, elle, tente de concilier innovation et protection des libertés.

Avec son talent habituel pour transformer une question historique en règlement PDF de 842 pages.

Le danger invisible : la dépendance technologique

Autre problème majeur :

la souveraineté.

Car une partie des infrastructures numériques utilisées par les administrations européennes dépend déjà :

- de Microsoft,

- d’Amazon,

- de Google,

- d’OpenAI,

- ou d’entreprises spécialisées dans l’analyse massive de données.

Autrement dit :

les démocraties européennes pourraient bientôt gérer leurs services publics avec des briques technologiques étrangères.

Ce qui revient un peu à confier les clés de sa préfecture à des multinationales dont l’objectif principal reste, rappelons-le, de satisfaire leurs actionnaires avant la philosophie des Lumières.

Une démocratie peut-elle déléguer ses décisions ?

C’est la question centrale.

Parce qu’au fond, l’IA publique pose un problème philosophique immense :

quelles décisions peuvent être automatisées ?

Et lesquelles doivent impérativement rester humaines ?

Attribuer une aide sociale ?

Détecter une fraude ?

Évaluer un risque de récidive ?

Prioriser des contrôles ?

Décider d’une expulsion ?

Classer des citoyens selon leur comportement administratif ?

Chaque automatisation déplace une partie du pouvoir politique vers des systèmes techniques.

Et plus ces systèmes deviennent complexes, moins les citoyens sont capables de comprendre comment les décisions sont produites.

Une démocratie devient fragile lorsque les citoyens ne comprennent plus comment elle fonctionne.

Une démocratie devient dangereuse lorsque même ses dirigeants ne comprennent plus les outils qu’ils utilisent.

Le risque du “pilotage automatique”

Le véritable danger n’est peut-être pas une dictature spectaculaire façon science-fiction.

Le danger réel est beaucoup plus banal.

Et donc beaucoup plus probable.

Une société où :

- les décisions deviennent progressivement automatiques,

- les recours deviennent incompréhensibles,

- les administrations se cachent derrière les systèmes,

- et les responsables politiques expliquent qu’ils “suivent les recommandations des modèles”.

Autrement dit :

une dilution du pouvoir humain dans des mécanismes techniques.

Sans grand débat public.

Sans révolution visible.

Sans chars dans les rues.

Simplement par accumulation silencieuse de logiciels.

Comme souvent dans l’histoire moderne, les transformations les plus profondes arrivent sans bruit.

Et parfois avec un joli tableau PowerPoint intitulé :

“Optimisation des processus décisionnels dans le cadre d’une gouvernance agile et résiliente.”

Ce qui est généralement le moment exact où il faut commencer à s’inquiéter.